Se você já trabalhou com microsserviços, provavelmente está familiarizado com a famosa "sopa de portas". Seu banco de dados roda na 5432, o backend na 8080, o frontend na 3000, o cache na 6379... e a lista cresce.

Tradicionalmente, fomos ensinados que para dois serviços conversarem, eles precisam de um IP e de uma Porta TCP dedicada. Embora esse modelo seja a espinha dorsal da internet, em arquiteturas de software modernas, depender exclusivamente dele introduz latência (overhead do TCP), riscos de segurança (portas expostas) e um pesadelo de infraestrutura (o "Port Hell").

Para arquitetos de software e desenvolvedores seniores, entender o que existe além do tradicional localhost:porta é a diferença entre construir um sistema que "apenas funciona" e um sistema de alta performance, seguro e resiliente.

Abaixo, quero explorar as 5 principais alternativas modernas à comunicação baseada em portas TCP tradicionais.

1. Unix Domain Sockets (A Rota Expressa Local)

Se os seus serviços rodam no mesmo kernel (na mesma máquina física, VM ou no mesmo Pod do Kubernetes), forçar a comunicação a passar pela pilha de rede TCP é um desperdício de processamento.

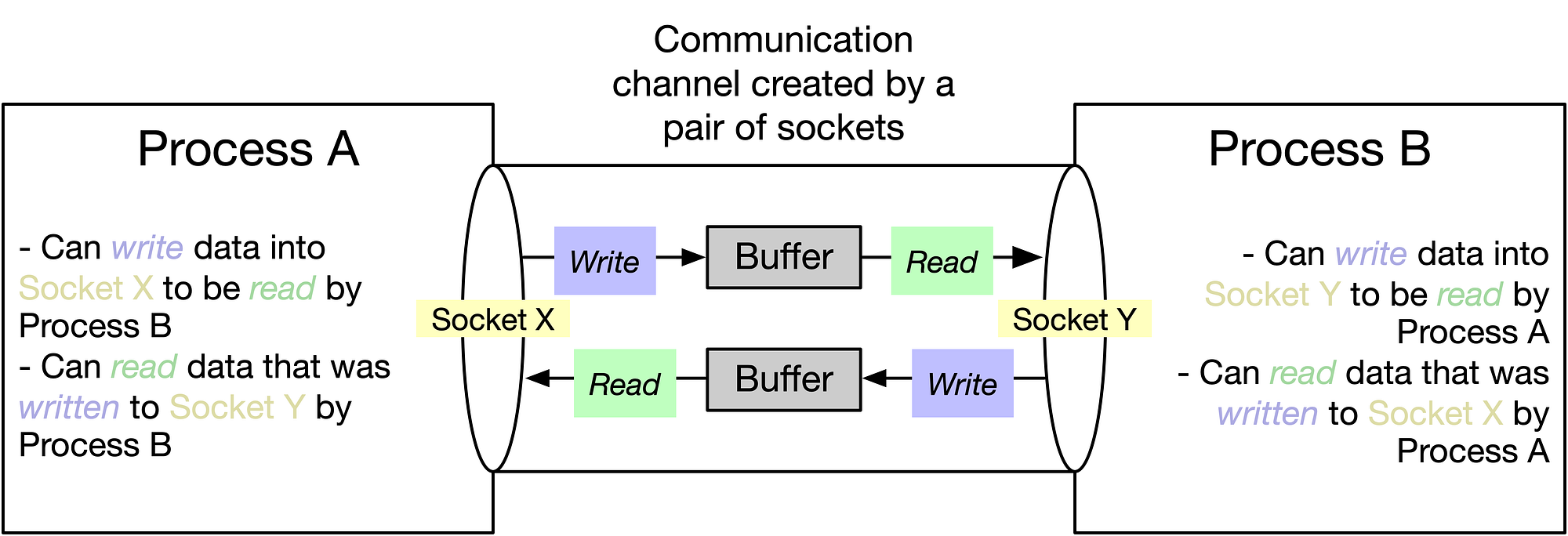

- Como funciona: Em vez de usar um IP e uma porta, o sistema operacional cria um arquivo especial (ex:

/var/run/docker.sock). Os processos leem e escrevem nesse arquivo. - Por que usar: Ele ignora completamente a complexidade da rede (roteamento, verificação de pacotes, handshakes). A comunicação ocorre diretamente na memória do kernel.

- Performance: Pode reduzir a latência e aumentar o throughput em 30% a 50% comparado ao TCP Loopback (

127.0.0.1). - Quem usa: O daemon do Docker, bancos de dados locais (Postgres) e proxies reversos (Nginx) para falar com backends na mesma máquina.

2. Protocol Multiplexing (O Fim das Múltiplas Conexões)

Em vez de abrir uma porta para cada funcionalidade ou serviço, você abre uma única "rodovia" e cria múltiplas "faixas" virtuais dentro dela.

- Como funciona (gRPC e HTTP/2): Eles utilizam streams binários. Você pode disparar milhares de requisições simultâneas e independentes sobre uma única conexão TCP/TLS.

- Multiplexadores puros (Yamux / Smux): Muito usados em Go e Rust. Permitem pegar uma única conexão de rede bruta e dividi-la em milhares de canais lógicos. Cada canal se comporta como se fosse uma porta separada, mas o firewall só enxerga uma única conexão aberta.

- Por que usar: Reduz drasticamente o consumo de recursos (File Descriptors) e simplifica regras de firewall.

3. Message Brokers e Service Bus (Comunicação Assíncrona)

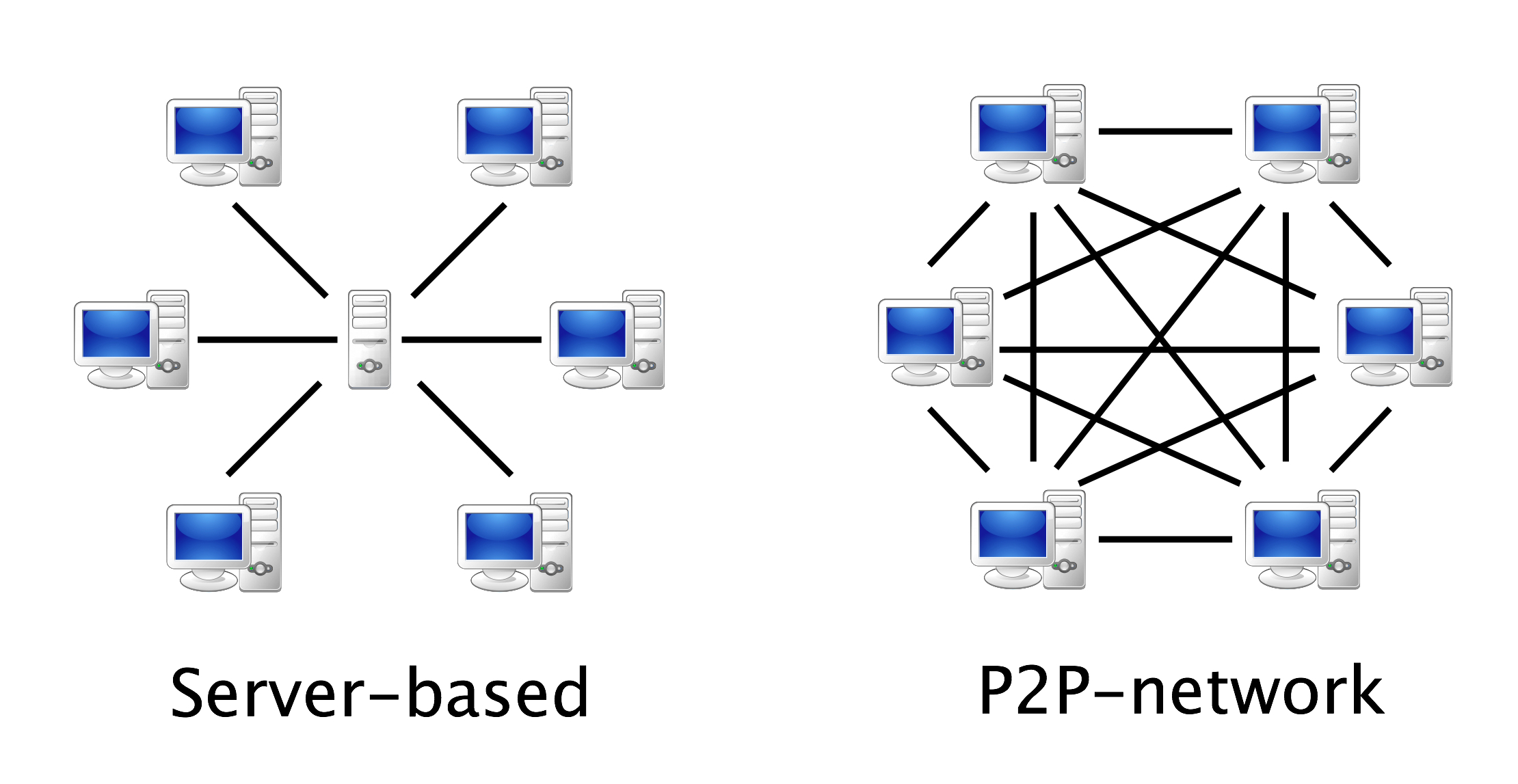

- Como funciona: Todos os processos se conectam a um nó central (Kafka, RabbitMQ, NATS ou Redis). Se o "Serviço A" precisa do "Serviço B", ele apenas publica um evento no Bus.

- Por que usar: Desacoplamento total. O Serviço A não precisa saber o IP, a Porta, ou sequer se o Serviço B está online naquele momento. Isso elimina a necessidade de Service Discovery complexos e portas expostas entre os nós.

4. Shared Memory (O Padrão Ouro de Baixa Latência)

Para cenários onde cada milissegundo custa dinheiro (como plataformas de trading) ou processamento massivo de dados (edição de vídeo em tempo real), até mesmo os Sockets Unix são lentos.

- Como funciona: Utiliza Memory-Mapped Files (mmap). O sistema operacional aloca um bloco de memória RAM e permite que dois processos distintos tenham acesso direto a ele. Se o Processo A altera um byte, o Processo B percebe no mesmo instante.

- Por que usar: Não existe "protocolo de rede", pacotes ou buffers de cópia. É a forma mais rápida fisicamente possível de dois programas conversarem no mesmo hardware (tempo medido em nanossegundos).

5. P2P e Negociação de Protocolo (A Revolução libp2p)

Este é o estado da arte para sistemas distribuídos, Web3 e Edge Computing. Em vez de você se conectar a uma Porta específica, você se conecta a um "Nó" e negocia o que ele sabe fazer.

Este é o estado da arte para sistemas distribuídos, Web3 e Edge Computing. Em vez de você se conectar a uma Porta específica, você se conecta a um "Nó" e negocia o que ele sabe fazer.

- Como funciona: Utilizando bibliotecas como o libp2p, dois nós se conectam por uma única porta. Eles iniciam um Multistream-select: "Ei, você suporta sincronização de arquivos?" -> "Não, mas suporto chat e gRPC".

- Por que usar: O software pode evoluir, novos serviços podem ser adicionados, e você continua usando uma única porta de comunicação. É a arquitetura definitiva para atravessar NATs e Firewalls restritivos sem complicação.

O que usar e quando?

A escolha da tecnologia dita a arquitetura do seu sistema. Aqui está um guia rápido:

| Contexto / Cenário | A Melhor Escolha | O Maior Benefício |

|---|---|---|

| Microsserviços no mesmo servidor/Pod | Unix Sockets | Segurança extrema (não acessível via rede) e velocidade. |

| Comunicação entre APIs na Nuvem | gRPC (Multiplexing) | Tipagem forte, compressão e economia de conexões. |

| Arquitetura Orientada a Eventos | Message Bus (Kafka/NATS) | Desacoplamento e resiliência (sem dependência direta). |

| Alta Performance (Fintech / Games) | Shared Memory | Latência zero (comunicação direta na RAM). |

| Sistemas Distribuídos / IoT / P2P | libp2p (Negociação) | Flexibilidade, auto-descoberta e travessia de firewall. |

Por que dominar essas estruturas é crucial?

Sair do vício da "porta TCP para tudo" não é apenas preciosismo técnico; é uma decisão estratégica:

- Segurança (Superfície de Ataque): A regra fundamental de infraestrutura é: porta aberta é porta atacada. Usar Multiplexação ou Sockets locais reduz sua superfície de ataque a praticamente zero internamente.

- Gerenciamento de Infraestrutura: Se você possui 50 microsserviços, gerenciar tabelas de IPs, portas e conflitos é insustentável. Estruturas desacopladas (Message Bus) ou multiplexadas simplificam absurdamente o deploy e a orquestração via Kubernetes.

- Eficiência de Custos: Menos conexões abertas significam menos uso de CPU para gerenciar o estado da rede (overhead TCP), permitindo rodar mais serviços usando menos poder computacional na nuvem.

O modelo tradicional de redes nos trouxe até aqui, mas o futuro do software de alta performance exige pensarmos fora da caixa — ou melhor, fora da porta.

Gostou do artigo? Já implementou alguma dessas soluções (como gRPC ou Kafka) no seu ambiente? Deixe um comentário compartilhando sua experiência com os desafios da comunicação entre serviços!